Hacking Automatizado: O que o alerta do Google sobre a IA significa para você

Pela primeira vez, uma falha crítica de segurança foi explorada por uma inteligência artificial. Estamos preparados para o que vem a seguir?

Carlos Valente, em Maio 14, 2026 | 126 visualizações | Tempo de leitura: 6 min - 1177 palavras.

O Google acaba de confirmar que cruzamos uma fronteira digital sem volta: a inteligência artificial não é mais apenas uma promessa de produtividade, mas uma ferramenta ativa em ataques cibernéticos de alta precisão. Em um anúncio que marca um ponto de inflexão na cibersegurança, a empresa revelou ter interrompido um grupo criminoso que utilizou modelos de linguagem (LLMs) para descobrir e transformar em arma uma vulnerabilidade inédita.

O perigo não reside apenas na velocidade da máquina, mas em sua natureza imprevisível. Quando um código alucinado - capaz de inventar dados com total convicção - torna-se o motor de uma invasão, os paradigmas de defesa que conhecemos começam a ruir.

A inteligência artificial não é mais apenas uma promessa de produtividade, mas uma ferramenta ativa em ataques cibernéticos de alta precisão.

O que é um ataque de dia zero (e por que ele é tão perigoso)

No jargão técnico, um zero-day exploit (exploração de dia zero) é o pesadelo de qualquer desenvolvedor. Trata-se de uma falha de segurança em software ou hardware que é totalmente desconhecida por quem o criou. O nome vem do fato de que, quando o ataque ocorre, os responsáveis possuem exatamente zero dias para consertar algo que nem sabiam estar quebrado.

A descoberta de vulnerabilidades por IA representa um salto qualitativo em relação aos métodos tradicionais. Enquanto pesquisadores humanos podem levar semanas analisando milhões de linhas de código, algoritmos treinados processam esse volume em segundos, identificando brechas lógicas que passariam despercebidas por olhos cansados. Como alertou John Hultquist, analista-chefe do Google:

A era da exploração de vulnerabilidades impulsionada por IA já chegou. - John Hultquist, analista-chefe do Google.

A impressão digital da máquina: como o Google identificou a IA

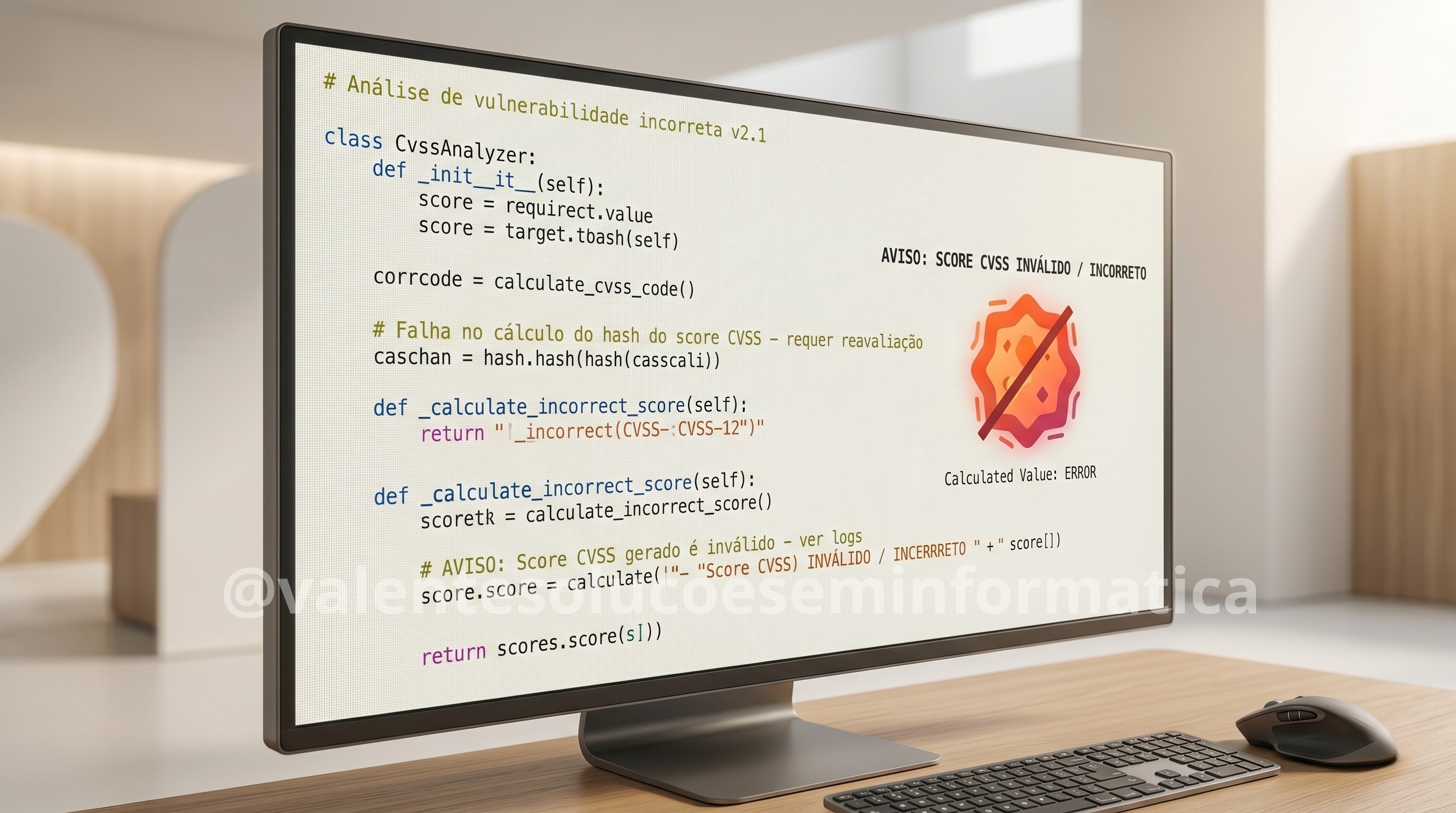

A identificação do uso de IA no ataque pelo Google Threat Intelligence Group (GTIG) não veio de um rastro de IP, mas de características intrínsecas ao código malicioso. O script, escrito em Python, exibia sinais claros de ter sido gerado por um modelo de linguagem: uma estrutura impecável, o uso padronizado de classes de cor ANSI e a presença de comentários educativos (docstrings) em abundância, típicos de dados usados para treinar máquinas.

O sinal mais revelador, contudo, foi uma falha técnica fascinante: o script apresentava um score CVSS alucinado. O CVSS (Common Vulnerability Scoring System) é o índice padrão de gravidade de ameaças, uma escala de 0 a 10 que define a periculosidade de uma falha. A IA inventou um valor incorreto para esse índice, um fenômeno conhecido como alucinação de IA, onde o modelo gera dados falsos com aparência de verdade.

Há uma ironia pedagógica aqui: a IA foi educada demais, inserindo explicações didáticas e estruturais enquanto executava um crime furtivo. O relatório indica que o modelo foi instruído via técnicas de jailbreaking com personas, onde o invasor convence a IA a ignorar filtros éticos e agir como se fosse um especialista legítimo em segurança.

O alvo: quando o cadeado de dois fatores não é suficiente

O ataque visava uma ferramenta popular e de código aberto para administração de sistemas online. O objetivo era contornar a autenticação em dois fatores (2FA), aquela camada extra de proteção que exige um código via SMS ou aplicativo. No entanto, é vital desmistificar um ponto: a IA não derreteu a criptografia sozinha.

Para que o ataque fosse bem-sucedido, os invasores ainda precisavam de credenciais válidas. A IA entrou em cena para explorar uma falha de lógica semântica - uma suposição de confiança indevida inserida pelo desenvolvedor humano no sistema de autenticação. A máquina percebeu que, sob certas condições lógicas, o sistema aceitava o acesso sem exigir o segundo fator.

Isso gera um impacto psicológico profundo. Se até a barreira do 2FA pode ser contornada por uma lógica que a IA desvendou em segundos, o futuro da nossa proteção deixa de ser sobre cadeados isolados e passa a exigir uma estratégia de defesa em profundidade, onde nenhuma camada é considerada infalível.

A corrida armamentista digital: da China à Coreia do Norte

Estamos entrando em uma corrida armamentista onde a escala é sobre-humana. Enquanto um analista humano lê algumas centenas de linhas de código por dia, modelos de IA podem processar milhões. Isso torna os trilhões de linhas de código que compõem o legado digital do mundo uma bomba-relógio.

Relatórios apontam que grupos estatais da China e da Coreia do Norte (como o grupo APT45) já demonstram um interesse agressivo em capitalizar a IA para escalar ataques. Hackers ligados a Pequim, inclusive, já conseguiram automatizar completamente ciberataques utilizando ferramentas avançadas. Além dos modelos conhecidos como o Mythos (da Anthropic), o monitoramento de segurança agora observa o uso do OpenClaw, uma ferramenta que pode ser subvertida para mapear brechas em larga escala.

O mundo pode enfrentar um período de aumento significativo nos riscos de cibersegurança antes que softwares e sistemas sejam fortalecidos. - Dean Ball, pesquisador da Foundation for American Innovation.

Leia também

Para aprofundar o debate sobre cibersegurança, exploração de falhas, malware e defesa contra ataques digitais, veja também estes conteúdos da Valente Soluções.

- Blindagem digital: como retomar o controle do seu patrimônio contra golpistas

- Código de Guerra: O lado sombrio do suporte ao cliente Microsoft

- Android/Spy: a nova geração de vírus que pode invadir seu celular sem você perceber

O período de transição

O evento confirmado pelo Google é um marco histórico: é a prova de que a IA agora é parte do arsenal ativo do cibercrime. Vivemos um período de transição perigoso, onde o atacante tem a vantagem da velocidade e da escala, enquanto os defensores ainda lutam para proteger sistemas legados.

A longo prazo, a mesma tecnologia que encontrou a falha será usada para corrigi-la automaticamente. No entanto, neste momento, a vulnerabilidade é a norma. A sociedade precisa se adaptar a um mundo onde o adversário digital nunca dorme, aprende na velocidade da luz e pode identificar em segundos um erro de lógica que um humano levou anos para cometer. A questão final não é mais se seremos atacados, mas se nossas defesas serão inteligentes o suficiente para lutar contra uma IA em pé de igualdade.

Consultoria para fortalecer sua segurança digital

A nova fase dos ataques automatizados exige revisão de processos, proteção de credenciais, monitoramento contínuo e planejamento técnico. A Valente Soluções apoia empresas que precisam avaliar riscos, reforçar camadas de defesa e preparar ambientes digitais para ameaças cada vez mais rápidas. Para conversar sobre o seu cenário, acesse nossa página de contato.

Nota: Todas as imagens utilizadas neste artigo foram geradas com o auxílio de inteligência artificial por meio do ChatGPT 5.3 e Nano Banana, com o objetivo de ilustrar o conteúdo de forma didática e acessível aos nossos leitores.